谷歌宣布推出Cloud TPU v5p,迄今为止最强大的人工智能加速器

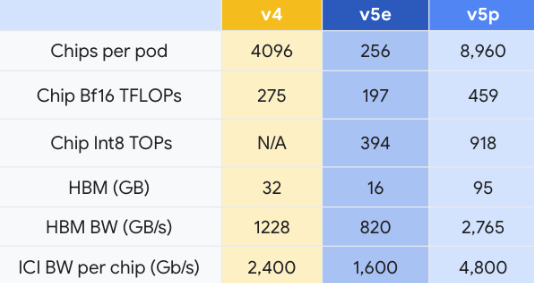

谷歌今天宣布推出了全新的巨石语言模型(Gemini LLM),与此同时,该公司还推出了全新的云TPU v5p,这是其今年早些时候推出的云TPU v5e的升级版本。一个v5p资源池由共计8,960个芯片组成,且受到谷歌迄今最快的互连技术支持,每个芯片的传输速率可达4,800 Gbps。

谷歌承诺这些芯片比v4 TPU快得多并不奇怪。该团队声称,v5p的FLOPS性能提升了2倍,高带宽内存性能提升了3倍。虽然这有点像将新的Gemini型号与较旧的OpenAI GPT 3.5型号进行比较,但毕竟谷歌已经将技术推向了TPU v4之外。然而,在许多方面,v5e pods相比v4 pods有所下降,每个pod仅有256个v5e芯片,而v4 pods有4096个,每个v5e芯片的16位浮点性能为197 TFLOPs,而v4芯片为275 TFLOPs。对于新的v5p,谷歌承诺16位浮点性能最高可达459 TFLOPs,并支持更快的互连技术。

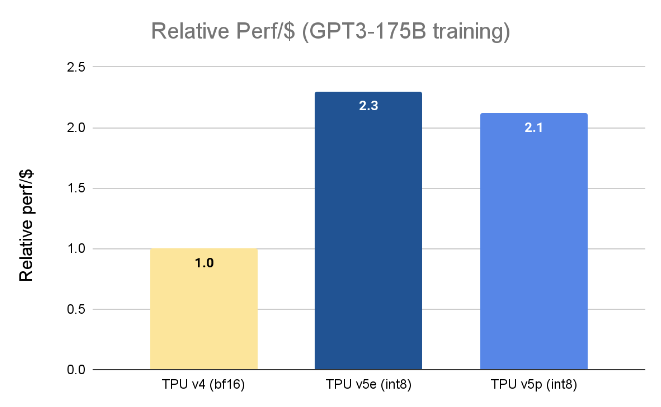

谷歌表示,这意味着TPU v5p可以比TPU v4更快地训练大型语言模型,如GPT3-175B,速度快2.8倍,并且更具成本效益(尽管TPU v5e的速度较慢,但每美元的性能相对于v5p来说更高)。

“在我们早期的使用阶段中,Google DeepMind和Google Research观察到TPU v5p芯片在LLM训练工作负载上相比于我们的TPU v4一代表现出2倍的加速”,Google DeepMind和Google Research的首席科学家Jeff Dean写道。“对于ML框架(JAX、PyTorch、TensorFlow)和编排工具的强大支持使我们能够在v5p上更高效地扩展。通过第二代SparseCores,我们还看到了嵌入式工作负载性能的显著改进。TPU对于我们在像Gemini这样的尖端模型上进行最大规模的研究和工程工作至关重要。”

目前新的TPU v5p还没有普遍供应,因此开发人员需要联系他们的Google账户经理以获取入选名单。