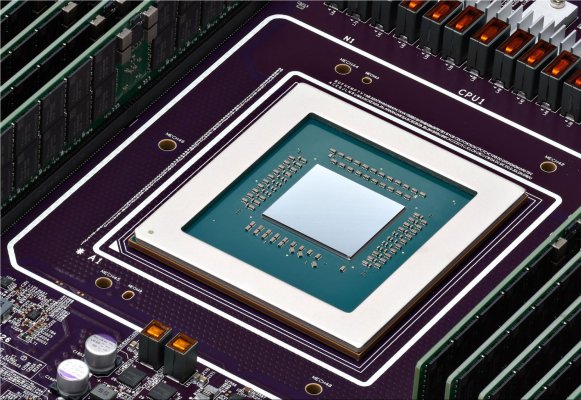

NVIDIA的下一代Blackwell平台将于2025年初进入谷歌云

本周在拉斯维加斯举行Google Cloud Next大会,这意味着一堆全新的实例类型和加速器即将登陆Google Cloud平台。除了全新的定制Arm芯片Axion外,今年大部分的新发布都是关于AI加速器,无论是由Google自己或是由Nvidia制造的。

仅仅几周前,Nvidia 宣布了它的 Blackwell 平台。但是不要指望谷歌很快提供这些机器。对于高性能的Nvidia HGX B200为AI和HPC工作负载以及GB200 NBL72为大语言模型(LLM)训练的支持将在2025年初到来。从谷歌的公告中得知一件有趣的事情:GB200 服务器将采用液冷技术。

这可能听起来有点过早地宣布,但英伟达自己表示,它的Blackwell芯片要到今年年底的最后一个季度才会公开发布。

在布莱克韦尔之前

为了满足开发者今日训练LLMs所需的更强大计算力,Google还宣布推出A3 Mega实例。该实例是与Nvidia合作开发的,采用了行业标准的H100 GPU,并结合了新的网络系统,可以为每个GPU提供高达两倍的带宽。

Google称另一个新的A3实例是A3保密实例,可以让客户在训练和推理过程中更好地保护敏感数据和AI工作负载的机密性和完整性。该公司长期以来一直提供加密使用数据的保密计算服务,启用后,保密计算将通过受保护的PCIe加密Intel的CPU和Nvidia H100 GPU之间的数据传输。Google表示,无需进行任何代码更改。

至于谷歌自家的芯片,该公司周二推出了其Cloud TPU v5p处理器,这是目前最强大的本土人工智能加速器,已经正式推向市场。这些芯片每秒浮点运算性能提高了2倍,内存带宽速度提高了3倍。

所有这些快速芯片需要一个能跟得上它们的基础架构。因此,除了推出新芯片之外,谷歌周二还宣布了新的人工智能优化存储选项。Hyperdisk ML是公司的下一代块存储服务,目前正在预览阶段,据谷歌称,它可以将模型加载时间提高最多3.7倍。

谷歌云还推出了一系列更传统的实例,由英特尔第四和第五代至强处理器提供支持。例如,新的通用用途C4和N4实例将采用第五代Emerald Rapids至强处理器,其中C4注重性能,而N4注重价格。新的C4实例目前正在进行私人预览,而N4机器已经正式上线。

此外,还有新推出的C3裸金属服务器,使用老一代的Intel Xeons处理器,还有X4内存优化的裸金属实例(仍处于预览阶段),以及Z3,谷歌云首款存储优化的虚拟机,承诺提供“在主要云服务提供商中拥有存储优化实例的最高IOPS”。