模特太多了

有太多的AI模型会是多少呢?这要看你怎么看待...但每周10个可能有点过头了。这就是我们在过去几天拥有的数量,或接近这个数字,越来越难以判断这些模型彼此之间的比较是否合理 — 如果这种比较起初就有可能话。那么问题是什么?

我们处于人工智能发展的一个奇怪时期,尽管当然整个时间都很奇怪。我们看到了大大小小的模型大量涌现,从小众开发者到大型、资金充裕的公司。

让我们从这周的清单上一起看一遍,好吗?我尽可能地概括了每个模型的特点。

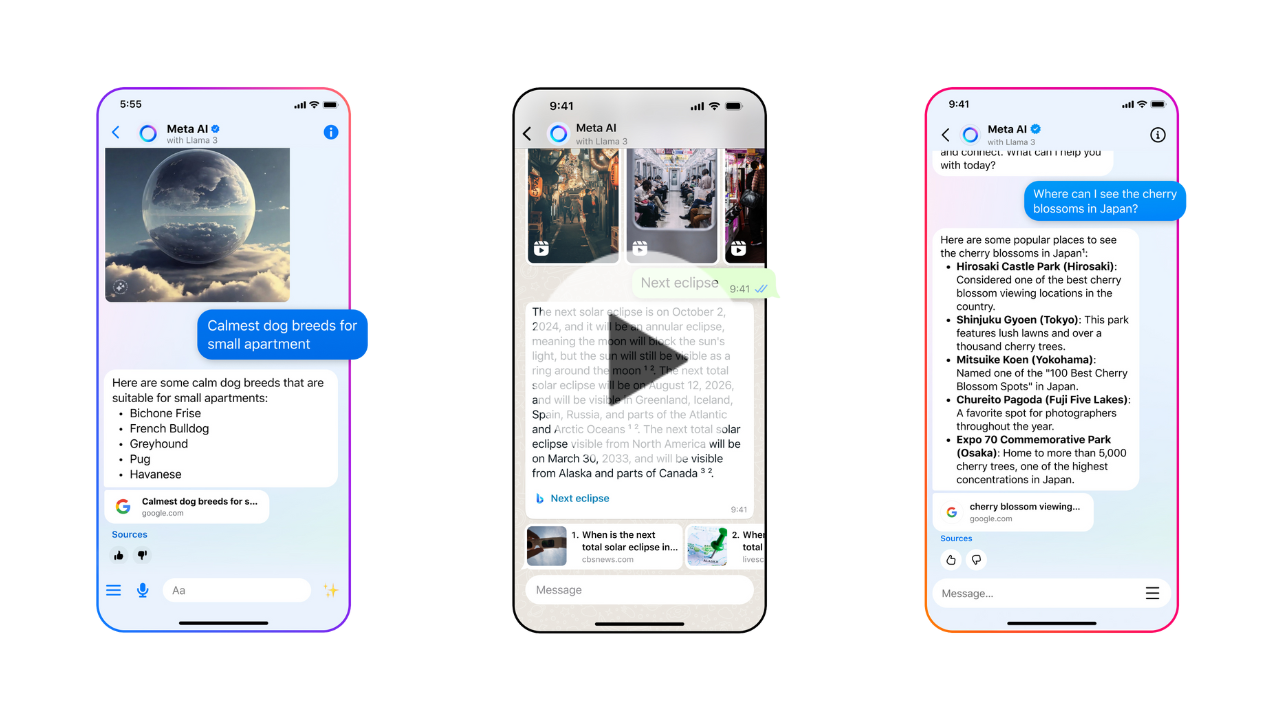

- LLaMa-3:Meta最新的“开放”旗舰大语言模型。(目前“开放”一词存在争议,但这个项目在社区中被广泛应用。)

- 迷雾8×22:这是一个来自法国厂家的“专家混合”模型,规格较大,他们已经回避了他们曾经拥抱过的开放性。

- 稳定扩散3 Turbo:升级版的SD3适用于开放式的Stability新API。从OpenAI的模型命名中借用“turbo”有点奇怪,但还可以RAD. is. is . . if . The The Lu . of just, . an R. is this . The The rough lock. . There. Pat of of a of of . a with An a sum do.

- Adobe Acrobat AI助手:与您的文档交谈。这是来自800磅文件猩猩的功能。我很确定这主要是ChatGPT的包装。

- Reka核心:由之前在大型人工智能公司工作过的小团队开发,从头开始打造的多模态模型,至少在名义上与大公司有竞争力。

- Idefics2: 一个更开放的多模态模型,建立在最近较小的 Mistral 和 Google 模型之上。

- OLMo-1.7-7B是AI2的LLM的一个更大的版本,是目前最开放的版本之一,也是未来70B规模模型的一个基石。

- Pile-T5:T5模型的一个版本,在Pile代码数据库上进行了优化。您熟悉和喜爱的T5,但编码效果更好。

- Cohere Compass: 一种“嵌入模型”(如果你不知道,不用担心)专注于整合多种数据类型,以涵盖更多使用情况。

- 想象闪光:Meta 最新的图片生成模型,依赖于一种新的提炼方法来加速扩散,而不会过度损害质量。

- 无限:一个以你所见、说过或听过的内容为基础的个性化人工智能。它是一个网络应用、Mac 应用、Windows 应用和可穿戴设备。😬

这里一共有11个模型,因为我在写这篇文章的时候还有一个新模型发布。要明确一点,这并不是本周发布或预览的所有模型!这只是我们看到并讨论的一些。如果我们放宽了一点收录条件,这个数字可能会增加到几十个:一些调整过的现有模型,一些类似Idefics 2的组合,一些实验性的或者小众的模型等等。更不用说本周新发布的用于构建(torchtune)和对抗(Glaze 2.0)生成式人工智能的工具!

我们应该如何看待这不断不息的雪崩呢?因为下周,虽然可能不像上周那样有十几个或二十个新产品发布,但肯定至少会有五六个属于上述类型的新产品。我们无法“审查”所有这些产品。那么我们如何能够帮助我们的读者理解并跟上所有这些事情呢?

事实是你不需要跟上,其他几乎没有人需要。AI领域发生了变化:一些模型,如ChatGPT和Gemini,已经发展成整个跨越多个用例和访问点的网络平台。其他大型语言模型如LLaMa或OLMo,尽管从技术上讲它们分享相同的基本架构,但实际上并不担任相同的角色。它们旨在作为服务或组件存在于后台,而不是以品牌名称出现在前台。

有人有意混淆这两件事,因为模型开发者们想借用我们常常将其与像你的GPT-4V或Gemini Ultra这样的重要人工智能平台发布联系在一起的热闹气氛。每个人都希望让你觉得他们的发布很重要。虽然这对某人可能很重要,但这个某人几乎肯定不是你。

把它看作另一种广泛而多样的类别,就像汽车一样。当汽车首次发明时,你只是买了“一辆汽车”。然后不久之后,你可以在大车、小车和拖拉机之间选择。如今,每年都会推出数百款汽车,但你可能并不需要了解其中有十分之一的汽车——因为十辆中有九辆不是你需要的汽车,甚至不是你理解的汽车。我们正在从人工智能的大/小/拖拉机时代转向扩散时代,即使是人工智能专家也无法跟上并测试所有新推出的模型。

这个故事的另一面是,我们早在ChatGPT和其他大型模型出现之前就已经处在这个阶段。7或8年前读到这方面的内容的人要少得多,但我们仍然报道了这个领域,因为显然这是一个等待爆发时刻的技术——而这个时刻终将到来。各种论文、模型和研究不断涌现,SIGGRAPH和NeurIPS等会议上充满着机器学习工程师们相互交流并借鉴彼此的工作。这是我2011年写的一个关于视觉理解的故事!

这项活动每天仍在进行。但由于人工智能已经成为一个大生意,可以说是当前科技领域中最大的生意,这些进展已经被赋予了一些额外的重要性,因为人们想知道是否有其中之一会是ChatGPT之于其前任的大跨越。

简单的事实是,这些模型中没有一个会取得重大进展,因为OpenAI的进步是建立在对机器学习体系结构的根本性改变上的,每家公司现在都已经采用了这种改变,而且尚未被超越。目前我们所期待的只是在合成基准测试中稍微更好一点或两点,或者在语言或图像方面更具说服力的微小改进。

这是否意味着这些模型都无关紧要?当然不是。你不可能在没有2.1、2.2、2.2.1等版本的情况下从2.0升级到3.0 — 这正是研究人员和工程师们正努力工作的内容。有时,这些进步是有意义的,能够解决严重缺陷或暴露出意想不到的漏洞。我们努力覆盖有趣的内容,但那只是少数。我们正在准备一篇文章,汇总所有我们认为对机器学习有兴趣的人应该知道的模型,大约有十多个。

不用担心:当一个大事件发生时,你会知道的,不仅仅是因为TechCrunch在报道。这对你来说会和我们一样显而易见。