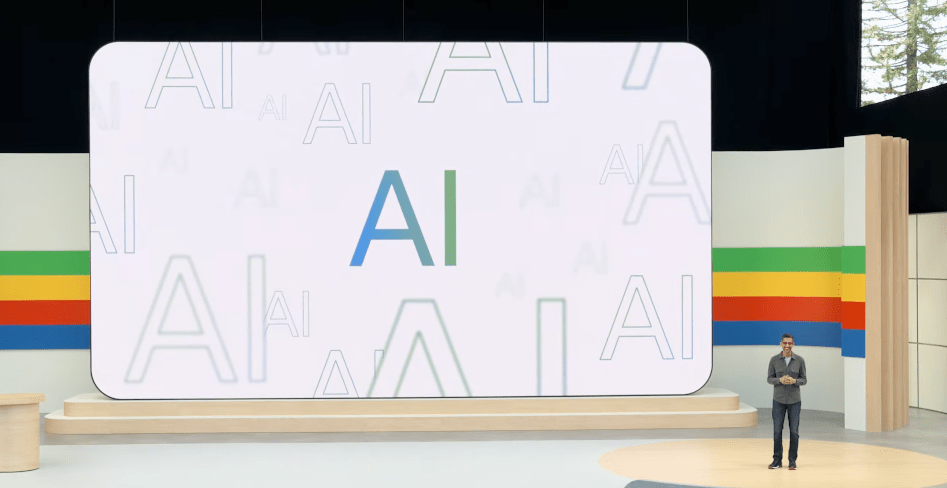

谷歌承认其人工智能概述需要改进,但我们都在帮助它进行测试

谷歌对其人工智能摘要也感到尴尬。在过去一周里,谷歌遭到了大量批评和恶搞,人们对这家科技巨头的新人工智能搜索功能的质量不佳和出现的错误信息纷纷吐槽。周四,谷歌公司发表了一种类似认错的声明。作为一家公司,其名字是与网络搜索同义的,其品牌专注于“整理世界信息”并使用户尽在指尖,竟然在博客中写道:“一些奇怪、不准确或无用的人工智能摘要确实出现了。”

这只是轻描淡写而已。

由谷歌副总裁兼搜索负责人利兹·里德撰写的承认失败的声明似乎证明,将人工智能技术应用到一切上,如今在某种程度上使谷歌搜索变得更糟。

在题为“关于上周”的帖子中(这个被批准了吗?),Reid详细解释了其人工智能总览出现错误的多种方式。她说,虽然它们不像其他大型语言模型那样“产生幻觉”或捏造东西,但它们可能因为“其他原因”而出错,比如“错误解释查询、错误解释网络上语言的微妙之处,或者没有大量优质的信息可用”。

Reid还指出,过去一个星期在社交媒体上分享的一些屏幕截图是伪造的,而其他一些则是针对毫无意义的查询,比如“我应该吃多少块石头?” ——这是以前从未有人真正搜索过的。由于这个话题上几乎没有真实的信息,谷歌的人工智能引导用户到了讽刺内容。(就石头来说,这个讽刺内容曾经发表在地质软件提供商的网站上。)

值得指出的是,如果你在谷歌上搜索“我应该吃多少块石头?”,然后得到一系列毫无帮助的链接,甚至是一篇滑稽的文章,你一点也不会感到惊讶。人们所反应的是人工智能如此自信地回答说“地质学家建议每天至少吃一块小石头”,好像这是一个事实性的答案。从技术术语上来说,这可能不是“幻觉”,但最终用户并不在乎,这是疯狂的。

Reid还声称谷歌在推出之前进行了“大量测试”,包括进行了“强有力的红队测试”,这也让人感到不安。

难道谷歌没有人有幽默感吗?没有人想到会产生糟糕结果的搜索提示吗?

此外,谷歌淡化了人工智能功能对Reddit用户数据作为知识和真相来源的依赖。尽管人们长期以来经常在搜索中加上“Reddit”,以至于谷歌最终将其作为内置搜索过滤器,但Reddit并不是一个事实知识的集合。然而,人工智能会指向Reddit论坛帖子来回答问题,却没有理解第一手的Reddit知识何时有帮助,何时没有,甚至更糟糕的是何时是在搞恶作剧。

今天的Reddit通过向谷歌、OpenAI等公司提供数据来赚取利润,但这并不意味着用户希望谷歌的人工智能来决定何时在Reddit上搜索答案,或者建议某人的观点就是事实。学会何时在Reddit上搜索是有微妙之处的,而谷歌的人工智能还无法理解这一点。

正如Reid所承认的,“论坛通常是真实的第一手信息的好来源,但有些情况下会引导到不太有帮助的建议,比如使用胶水让奶酪粘在披萨上”,她提到了AI功能在过去一周中的一次较为惊人的失败。

Please come in and make yourself at home.

如果上周是一场灾难,不过,至少根据谷歌的说法,他们正在快速迭代。

该公司表示,它参考了人工智能概览的案例,并确定了一些可以改进的模式,包括建立更好的检测机制来识别无意义的查询,限制使用用户生成的内容来回应可能提供误导建议的问题,为人工智能概览无法提供帮助的查询添加触发限制,不在硬新闻话题上显示人工智能概览,“因为新鲜度和事实性很重要”,并为健康搜索的保护措施添加额外的触发精化。

随着人工智能公司每天构建不断改进的聊天机器人,问题不在于它们是否会超越谷歌搜索帮助我们了解世界信息,而是谷歌搜索能否追上人工智能的速度来挑战它们。

尽管谷歌的错误可能很荒谬,但现在还为时过早就把它排除在竞争之外——特别是考虑到谷歌的大规模测试人员,基本上是所有使用搜索的人。

Reid说:“没有什么能比得上数百万人使用这一功能进行许多新的搜索。”