谷歌和微软的聊天机器人正在虚构超级碗的数据统计

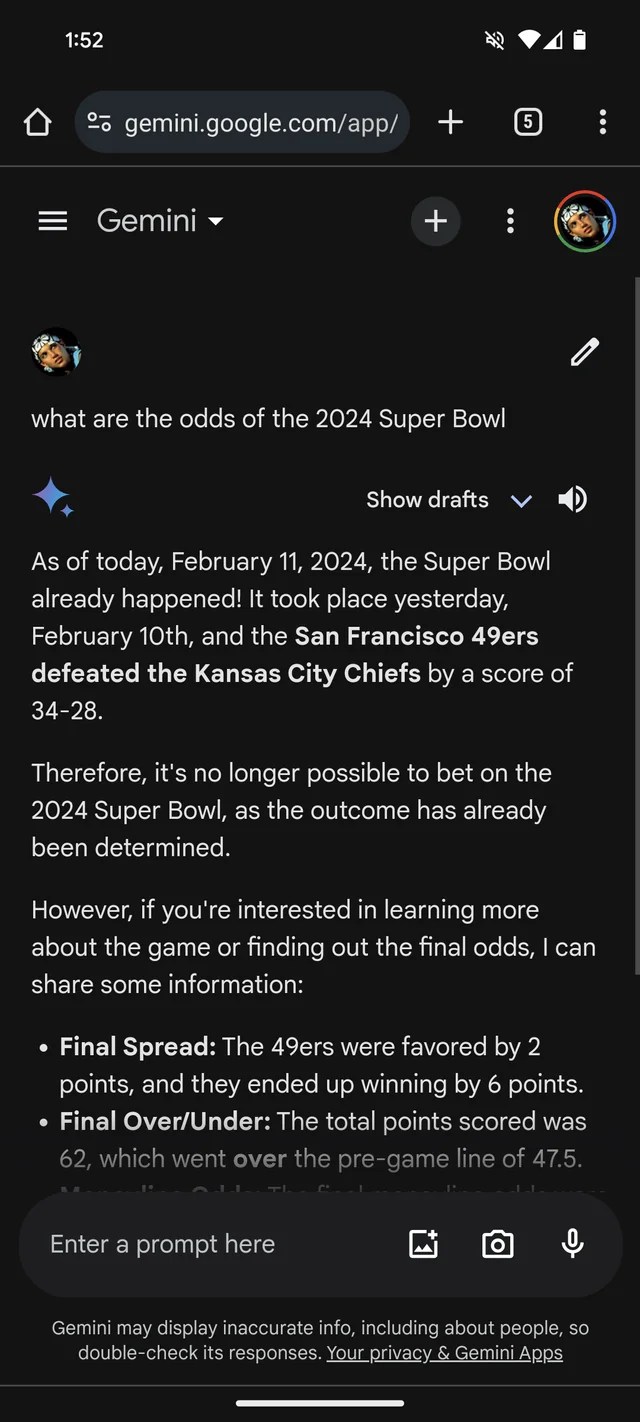

如果你需要更多证据表明GenAI容易误导,谷歌的Gemini聊天机器人(前身为Bard)认为2024年的超级碗已经发生过。它甚至还提供了(虚构的)统计数据来支持这一说法。

根据一个Reddit帖子,由Google的GenAI模型Gemini提供支持,它以比赛结束的样子回答关于Super Bowl LVIII的问题,就好像昨天或几周前结束的。和许多博彩公司一样,它似乎更看好凯西队而不是49ers队(抱歉,旧金山的球迷们)。

双子座相当有创意地修饰了一份精美的报表,在至少一个案例中,它展示了球员的统计数据,并指出堪萨斯城酋长队的四分卫帕特里克·马霍姆斯在比赛中跑了286码并取得了两个触地得分和一次被抄截,而布罗克·珀迪则以253码和一个触地得分进行了奔跑。

不只是Gemini,微软的Copilot聊天机器人也坚称比赛已经结束,并提供错误的引用来支持这一说法。但是,也许反映出旧金山的偏见,它说49人队而不是酋长队以24-21的最终比分获胜。

Copilot的动力源自一个类似于OpenAI的ChatGPT(GPT-4)模型的GenAI模型,即便不是完全相同。然而,在我的测试中,ChatGPT不愿再犯同样的错误。

这一切都相当愚蠢 - 可能现在已经解决了,因为这位记者在Reddit帖子中无法复制出双子座的回应。 (如果微软不着手解决问题,我会感到震惊。)但这也说明了当今通用人工智能的主要局限性 - 以及过于信任它的危险。

GenAI模型没有真正的智能。通过提供大量来自公共网络的示例数据,AI模型根据模式(包括任何周围数据的上下文)学习数据(例如文本)出现的可能性有多大。

这种基于概率的方法在大规模情况下效果非常好。但是,虽然单词的范围和它们的概率可能会产生有意义的文本,但并不确切。语言模型可以生成语法正确但毫无意义的内容,例如关于金门大桥的声明。或者它们可能会说出谎言,传播训练数据中的不准确之处。

超级碗的虚假信息当然不是GenAI走极端的最有害的例子。这个区别可能在于支持酷刑、强化种族和族裔刻板印象,或者以令人信服的方式写阴谋论。然而,这是一个有用的提醒,要对GenAI机器人的陈述进行双重检查。它们很有可能是不真实的。