本周人工智能新闻:Midjourney表示它能击败版权警察

跟上AI这个快速发展的行业并不容易。所以在AI可以帮你之前,这里有一些最近关于机器学习领域的重要故事和实验总结,以及我们没有单独报道的一些值得关注的研究成果。

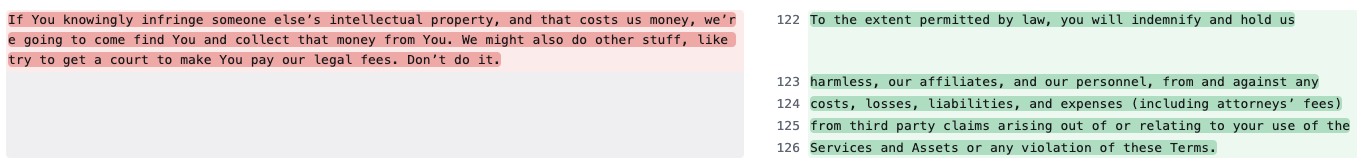

上周,人工智能初创公司Midjourney对其服务条款进行了一项微小的调整,涉及公司在知识产权纠纷方面的政策。这主要是将幽默的措辞改为更加律师化、基于案例法的条款。但这一变化也可以被视为Midjourney坚信像它这样的人工智能供应商将在法庭上与创作者展开战斗,并取得胜利的迹象。

中journey等生成式人工智能模型是在大量示例上进行训练的,例如来自公共网站和网络存储库的图像和文本。供应商声称公平使用是一个法律原则,允许使用受版权保护的作品进行二次创作,只要这是变换的,这种原则保护他们在模型训练方面。但并不是所有创作者都同意,特别是考虑到越来越多的研究显示,模型可以 - 并且确实会 - “反刍”训练数据。

一些供应商采取了积极主动的态度,与内容创作者签订许可协议,并设立了针对训练数据集的“选择退出”方案。其他供应商承诺,如果客户因使用供应商的GenAI工具而引发版权诉讼,他们不会为法律费用负责。

中途并不是那种主动性强的人。

相反,Midjourney 在使用受版权保护的作品时有些大胆,曾一度维护了一个数千名艺术家名单,包括主要品牌如Hasbro和Nintendo的插画师和设计师,他们的作品被用来训练Midjourney的模型。一项研究显示,Midjourney 在其训练数据中还使用了电视节目和电影系列,从《玩具总动员》到《星球大战》再到《沙丘》和《复仇者联盟》,有令人信服的证据表明。

现在,有一种情况是法院决定最终支持米德乔尼的方式。如果司法系统认为合理使用适用,那么没有任何事情能阻止这家初创公司继续以前的方式运营,利用旧的和新的受版权保护的数据。

但这看起来像是一次冒险的赌注。

目前Midjourney正风头正劲,据报道收入已达到约2亿美元,而没有任何外部投资。然而,律师费用是昂贵的。如果判定中间旅程的案件不适用公平使用原则,这将使公司一夜之间崩溃。

有风险就有回报,是吧?

以下是近几天一些引人注目的人工智能故事:

AI助力广告吸引了错误的关注:Instagram上的创作者对一位导演发出了抨击,他的商业广告重新使用了其他人(更难更令人印象深刻)的作品,而没有给予任何功劳。

欧盟当局在选举之前警告人工智能平台:他们要求科技巨头公司解释他们防止选举搞诡计的方法。

谷歌Deepmind希望您的合作游戏伙伴是他们的人工智能:通过对大量3D游戏游玩进行训练,使其能够执行用自然语言表达的简单任务。

基准测试存在的问题:许多人工智能供应商声称他们的模型在某些客观指标上已经超越或击败了竞争对手。但他们使用的指标通常是有缺陷的。

AI2获得2亿美元资金:AI2孵化器是从非营利机构艾伦人工智能研究所拆分出来的,成功获得2亿美元的资金,供参加其项目的初创企业利用加速早期发展。

印度要求政府批准人工智能,随后又收回要求:印度政府似乎无法决定人工智能行业适当的监管水平。

Anthropic发布新模型:人工智能初创公司Anthropic推出了一系列新模型,名为Claude 3,据称能与OpenAI的GPT-4匹敌。我们对旗舰模型(Claude 3 Opus)进行了测试,发现效果令人印象深刻,但在当前事件等方面还有欠缺。

政治深度伪造技术:英国非营利组织反对数字仇恨中心(CCDH)的一项研究关注过去一年在X(前称Twitter)上不断增加的人工智能生成的虚假信息,特别是与选举有关的深度伪造图像。

OpenAI对抗马斯克:OpenAI表示,他们打算驳斥近期一起诉讼中由前首席执行官埃隆·马斯克提出的所有主张,并暗示这位亿万富翁创业者对OpenAI的发展和成功并没有太大的影响,尽管他参与了公司的创立。

审查Rufus: 上个月,亚马逊宣布将在其适用于Android和iOS的Amazon购物应用中推出一个新的人工智能聊天机器人Rufus。我们提前获得了使用权限——但很快就对Rufus所能做的事情(以及做得好不好)感到失望。

更多的机器学习

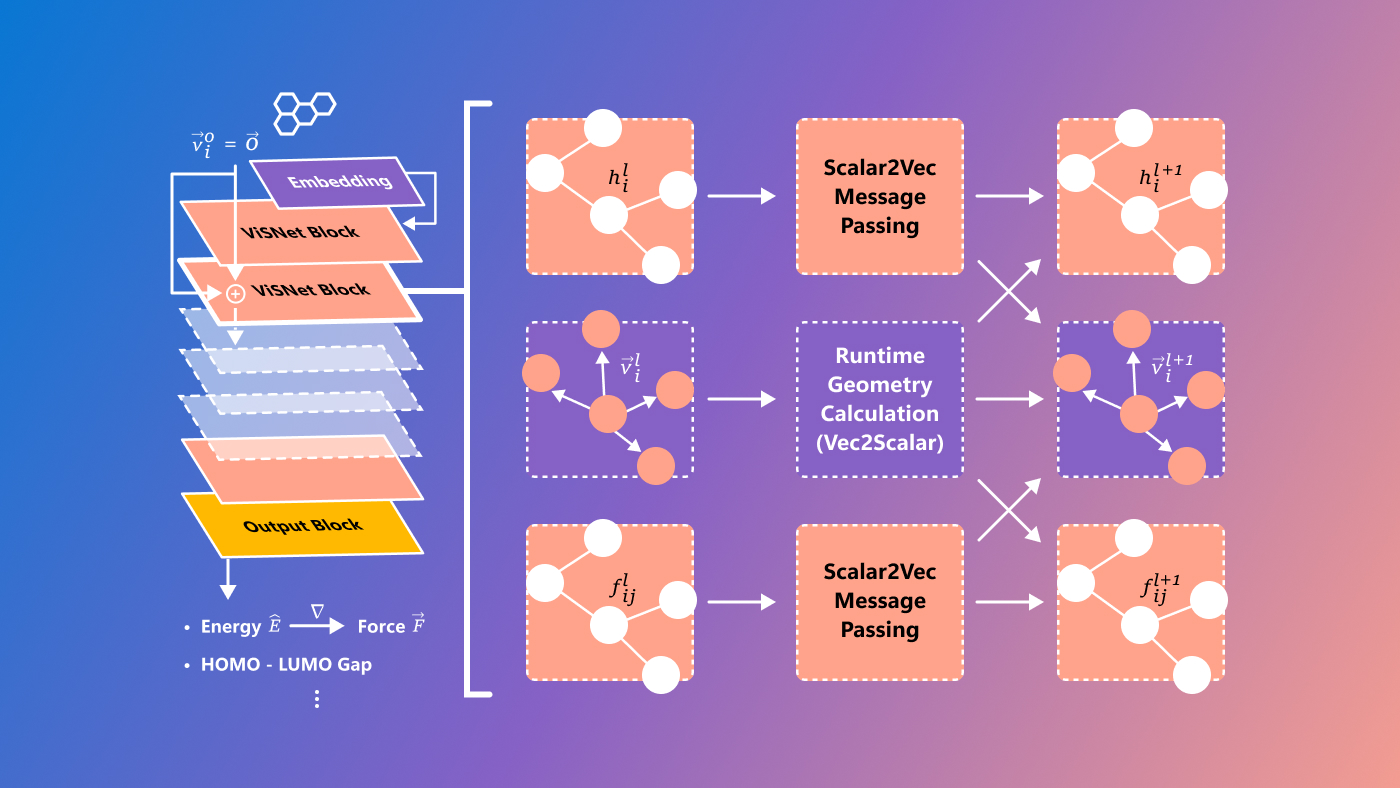

分子!它们是怎么运作的?人工智能模型在我们理解和预测分子动力学、构象和纳米世界的其他方面方面上发挥了很大的帮助。否则可能需要昂贵、复杂的方法来测试。当然,你仍然需要验证,但像AlphaFold这样的技术正在迅速改变这个领域。

微软推出了一个名为ViSNet的新模型,旨在预测所谓的结构活性关系,即分子和生物活性之间复杂的关系。这仍然是相当实验性的,绝对是专门针对研究人员的,但看到前沿技术手段解决硬科学问题总是令人振奋的。

曼彻斯特大学的研究人员专注于识别和预测COVID-19变种,不再仅仅依靠像ViSNet这样的纯结构,而更多地通过对有关冠状病毒演变的大量基因数据集的分析来进行研究。

首席研究员Thomas House表示:"疫情期间产生的前所未有的大量遗传数据要求我们改进方法,以彻底分析它。"他的同事Roberto Cahuantzi补充道:"我们的分析作为一个概念验证,展示了机器学习方法作为早期发现新兴重要变异的警报工具的潜力。"

人工智能也能设计分子,许多研究人员已经签署了一项倡议,呼吁在这一领域加强安全和道德。尽管全球最杰出的计算生物物理学家之一David Baker指出,“目前来看,蛋白质设计的潜在好处远远超过危险。”作为人工智能蛋白设计师,他当然会这么说。但我们仍需要警惕那些无视重点、阻碍合法研究、却让不法分子自由活动的监管。

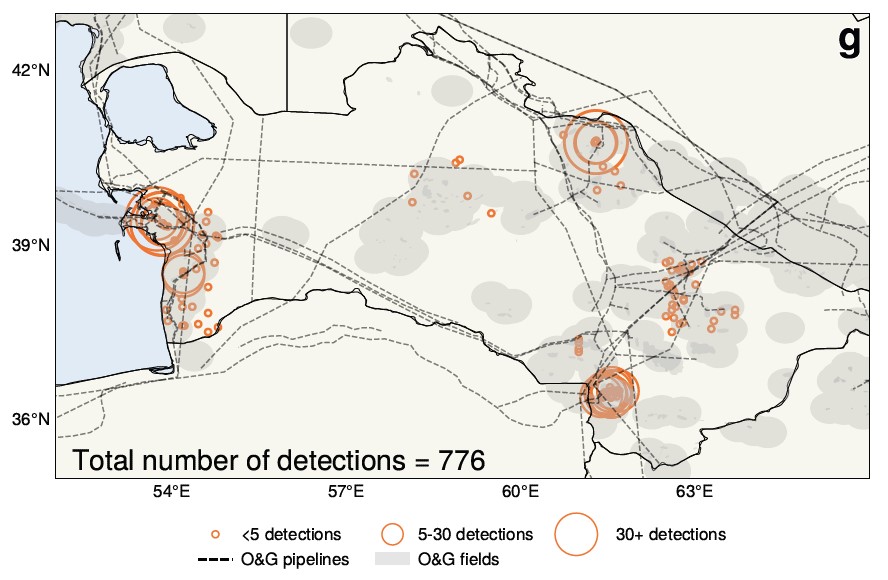

华盛顿大学的大气科学家们根据对土库曼斯坦25年卫星图像的AI分析,提出了一个有趣的说法。基本上,普遍认为苏联解体后经济动荡导致排放量减少的观点可能并不正确 - 实际上,相反的情况可能发生了。

“我们发现苏联解体似乎令甲烷排放量出现意外增加。”华盛顿大学教授亚历克斯·特纳表示。庞大的数据集和缺乏时间整理这些数据,使这个主题对人工智能成为一个自然的挑战目标,最终导致了这种意想不到的逆转。

大型语言模型主要是在英文数据上进行训练的,但这可能不仅影响它们在使用其他语言方面的能力。EPFL研究人员在研究LlaMa-2的“潜在语言”时发现,即使在法语和中文之间进行翻译时,该模型似乎在内部也会回归到英语。然而,研究人员指出,这并不仅仅是一个懒散的翻译过程,事实上,该模型已经将其整个概念潜在空间围绕英语观念和表征进行了结构化。这是否重要?可能是的。无论如何,我们应该多样化它们的数据集。