Meta发布Llama 3,声称它是目前最优秀的开放式模型之一

Meta发布了其Llama系列开源生成式人工智能模型的最新版本:Llama 3。更准确地说,该公司在其新的Llama 3系列中开源了两个模型,其余模型将在未来某个未指定的日期发布。

Meta将新模型Llama 3 8B(包含80亿个参数)和Llama 3 70B(包含700亿个参数)描述为与上一代Llama模型(Llama 2 8B和Llama 2 70B)相比,在性能上的“重大飞跃”。(参数基本上定义了人工智能模型在解决问题(如分析和生成文本)时的技能,参数数量更多的模型通常比参数数量较少的模型更有能力。)事实上,Meta表示,就参数数量而言,通过两个定制的24000个GPU集群训练的Llama 3 8B和Llama 3 70B模型是当今性能最佳的生成式人工智能模型之一。

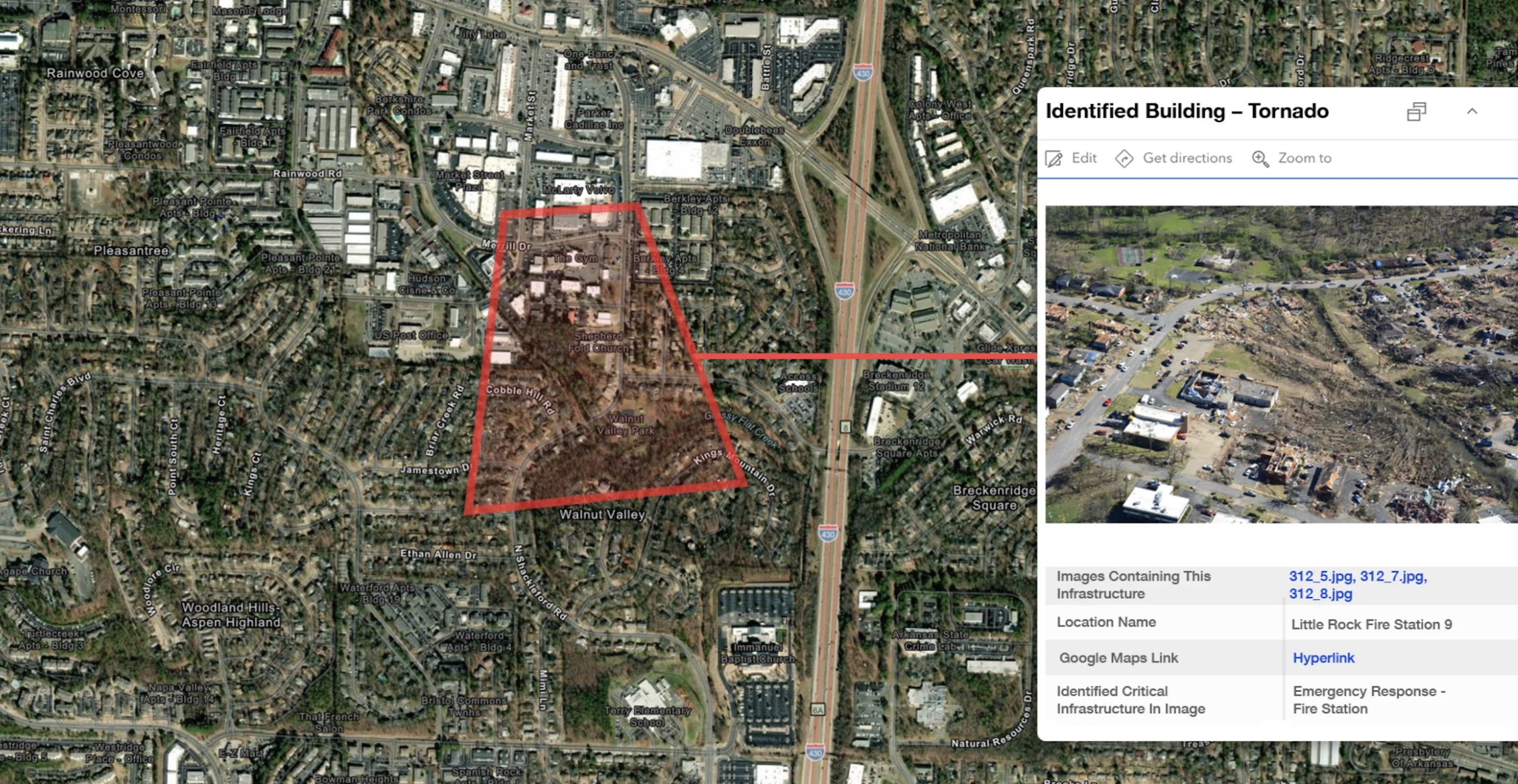

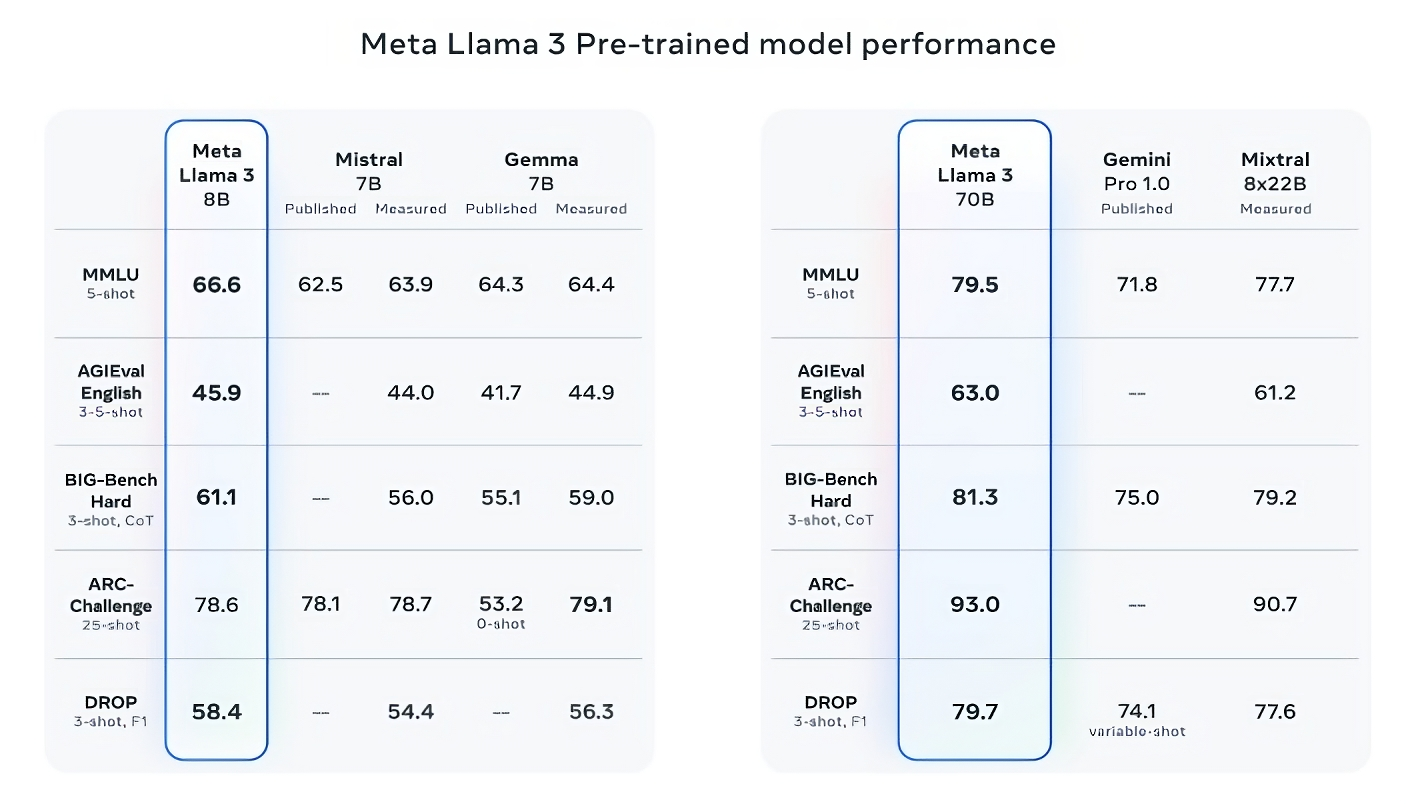

这个说法相当大胆。那么Meta是如何支持它的呢?嗯,该公司指出Llama 3款模型在像MMLU(试图衡量知识)、ARC(试图衡量技能习得)和DROP(测试模型对文本片段推理能力)等流行人工智能基准测试上的得分。正如我们之前提到的,这些基准测试的实用性和有效性存在争议。但不管好坏,它们仍然是像Meta这样的人工智能玩家评估模型的少数标准化方式之一。

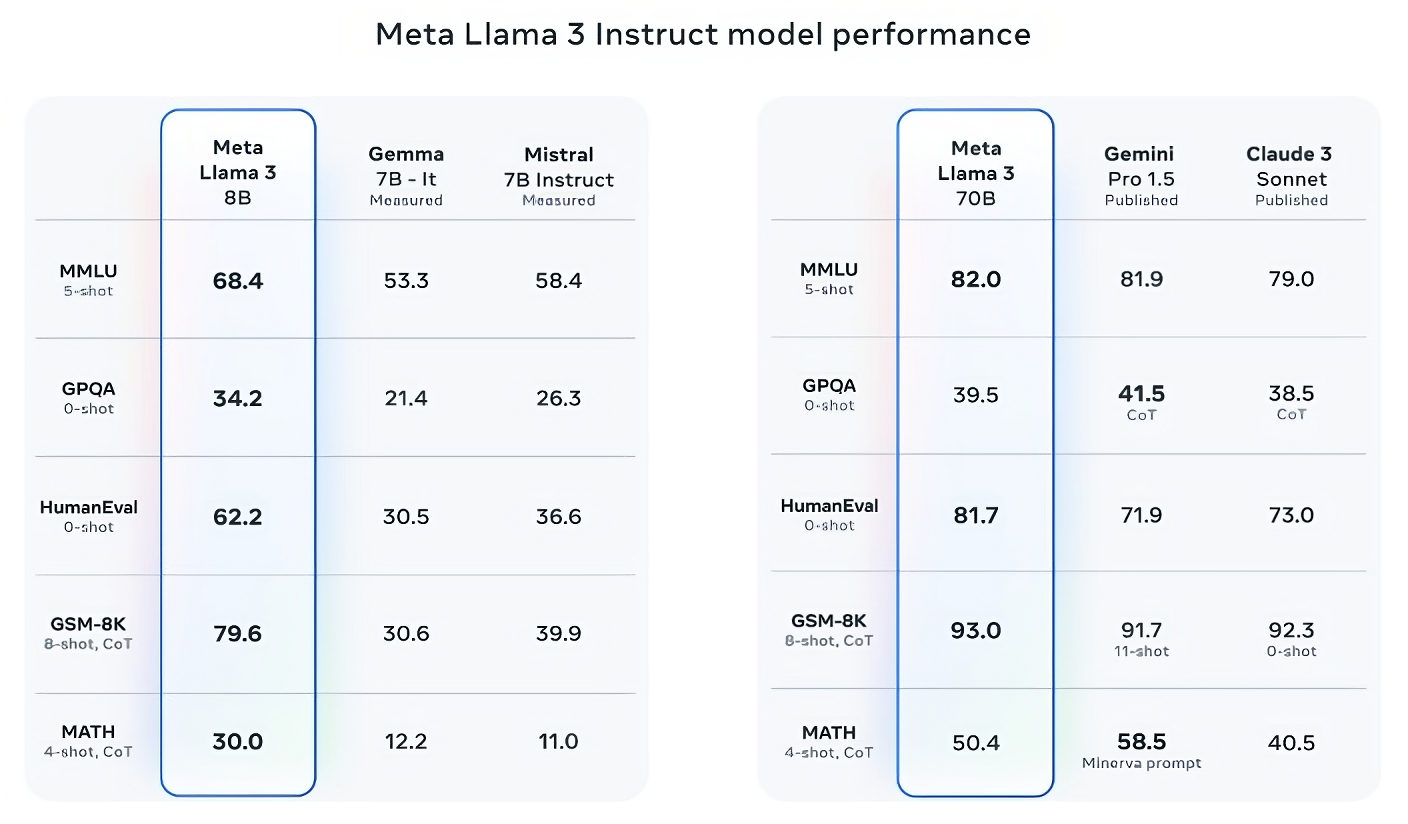

Llama 3 8B超越了Mistral的Mistral 7B和谷歌的Gemma 7B等其他开源模型,在至少九个基准测试中表现更好:MMLU、ARC、DROP、GPQA(一组涉及生物学、物理学和化学的问题)、HumanEval(代码生成测试)、GSM-8K(数学问题)、MATH(另一个数学基准测试)、AGIEval(问题解决测试集)和BIG-Bench Hard(常识推理评估)。

现在,Mistral 7B和Gemma 7B并不是最新技术(Mistral 7B是去年九月发布的),在一些基准测试中,Llama 3 8B的得分仅比它们高几个百分点。但Meta还声称,参数更多的Llama 3模型,Llama 3 70B,与旗舰生成式AI模型相竞争,包括谷歌Gemini系列最新的Gemini 1.5 Pro。

Llama 3 70B在MMLU、HumanEval和GSM-8K上击败Gemini 1.5 Pro,并且虽然它不能与Anthropic最强大的模型Claude 3 Opus相媲美,但Llama 3 70B在五个基准测试中(MMLU、GPQA、HumanEval、GSM-8K和MATH)比Claude 3系列中最弱的模型Claude 3 Sonnet表现更好。

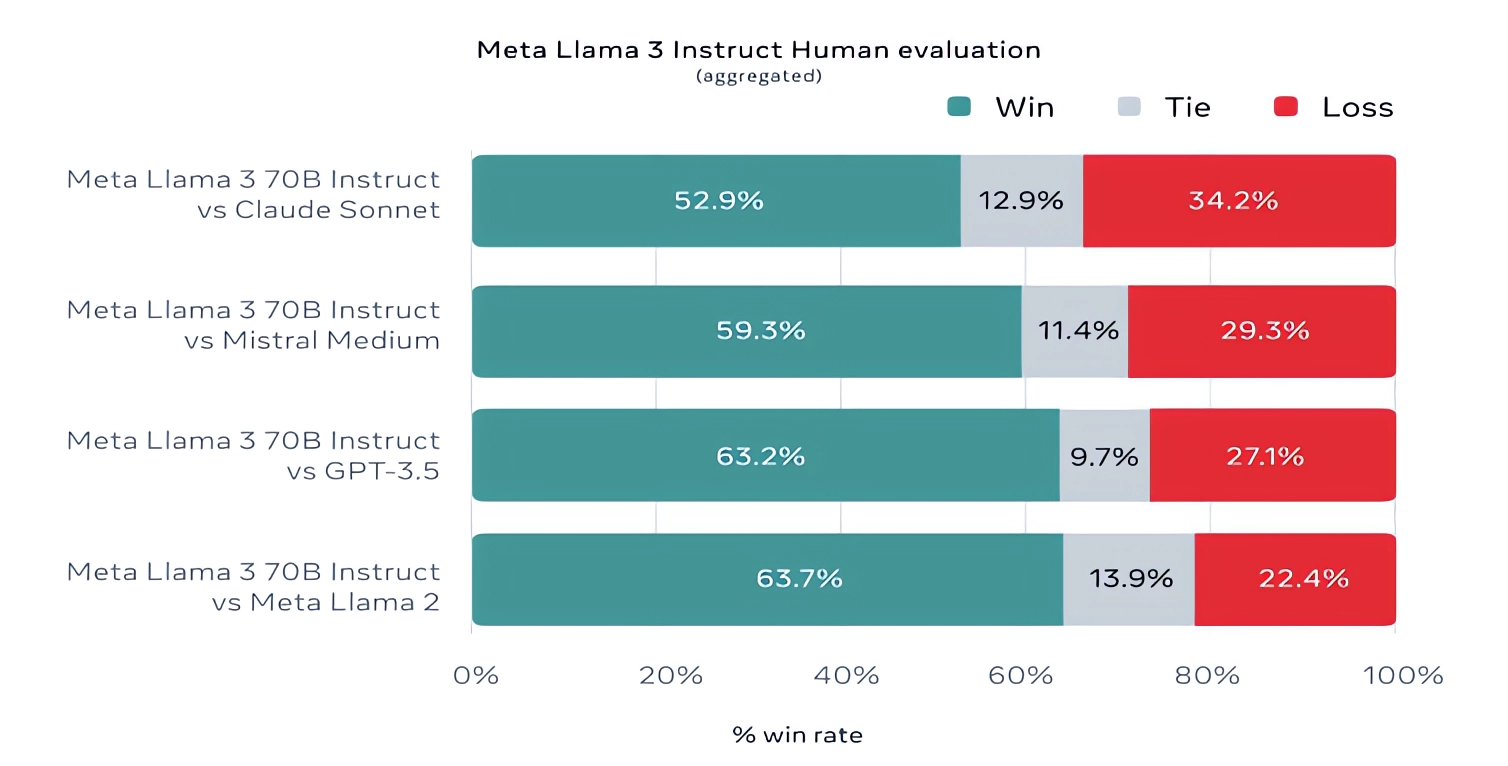

就说说而言,Meta还开发了自己的测试集,涵盖了从编码和创作写作到推理再到摘要等使用案例,而 — 惊讶! — Llama 3 70B 在 Mistral 的 Mistral Medium 模型、OpenAI 的 GPT-3.5 和 Claude Sonnet 之间脱颖而出。Meta称,为了保持客观性,他们限制了模型团队访问该测试集,但显然 — 鉴于Meta自身设计了测试 — 结果必须持保留态度。

Meta表示,新的Llama模型的用户在质量上应该更期待更多的“可操纵性”,更低的拒绝回答问题的可能性,以及更高的答题准确率,包括历史、STEM领域(例如工程和科学)以及一般编码建议。这在一定程度上得益于一个更大的数据集:一系列15万亿个令牌,或者令人难以置信的约750,000,000,000个单词 — 比Llama 2训练集大了七倍。(在人工智能领域,“令牌”指的是原始数据的细分位,就像单词“fantastic”中的音节“fan”、“tas”和“tic”一样。)

这些数据是从哪里来的?好问题。Meta并没有透露具体来源,只表示数据来自“公开可获取的资源”,而且包含的代码比Llama 2训练数据集多四倍,其中5%的数据集包含非英文数据(涉及约30种语言),用于提高英语以外语言的性能。Meta还表示他们使用了合成数据,即由人工智能生成的数据,来生成更长的文档供Llama 3模型训练,这是一种有争议的做法,因为可能会影响性能。

Meta在与TechCrunch分享的博客文章中写道:“尽管我们今天发布的模型仅针对英文输出进行了微调,但增加的数据多样性有助于模型更好地识别细微差别和模式,并在各种任务中表现出色。”

许多生成式人工智能供应商视训练数据为竞争优势,因此将其以及相关信息保持保密。但训练数据的详细信息也是知识产权相关诉讼的潜在来源,这也是不愿透露太多信息的原因之一。最近的报道显示,为了与人工智能竞争对手保持步伐,Meta曾一度使用受版权保护的电子书进行AI训练,尽管公司自己的律师发出了警告;Meta和OpenAI正面临一场持续进行中的诉讼,原告包括喜剧演员莎拉·西尔弗曼,指控供应商未经授权使用受版权保护的数据进行训练。

那么毒性和偏见这两个与生成式AI模型(包括Llama 2)常见的问题如何? Llama 3在这些领域是否有改进?是的,Meta声称有改进。

Meta表示,它开发了新的数据过滤管道,以提高其模型训练数据的质量,并更新了其一对生成式AI安全套件Llama Guard和CybersecEval,以防止Llama 3模型和其他模型的误用和不良文本生成。该公司还发布了一个名为Code Shield的新工具,旨在检测可能引入安全漏洞的生成式AI模型的代码。

过滤并非绝对可靠,例如类似Llama Guard,CybersecEval和Code Shield这样的工具只能起到一定作用。(参考:Llama 2有时候会编造答案并泄露私人健康和财务信息。)我们还需要等待观察Llama 3模型在野外的表现,包括学者们在其他基准测试中的评估结果。

Meta表示,Llama 3模型现已提供下载,并为Meta在Facebook、Instagram、WhatsApp、Messenger和Web上的Meta AI助手提供支持,很快将在包括AWS、Databricks、Google Cloud、Hugging Face、Kaggle、IBM的WatsonX、Microsoft Azure、Nvidia的NIM和Snowflake在内的各种云平台上以托管形式托管。未来,还将提供针对AMD、AWS、Dell、Intel、Nvidia和Qualcomm硬件优化的模型版本。

更多功能强大的模型即将问世。

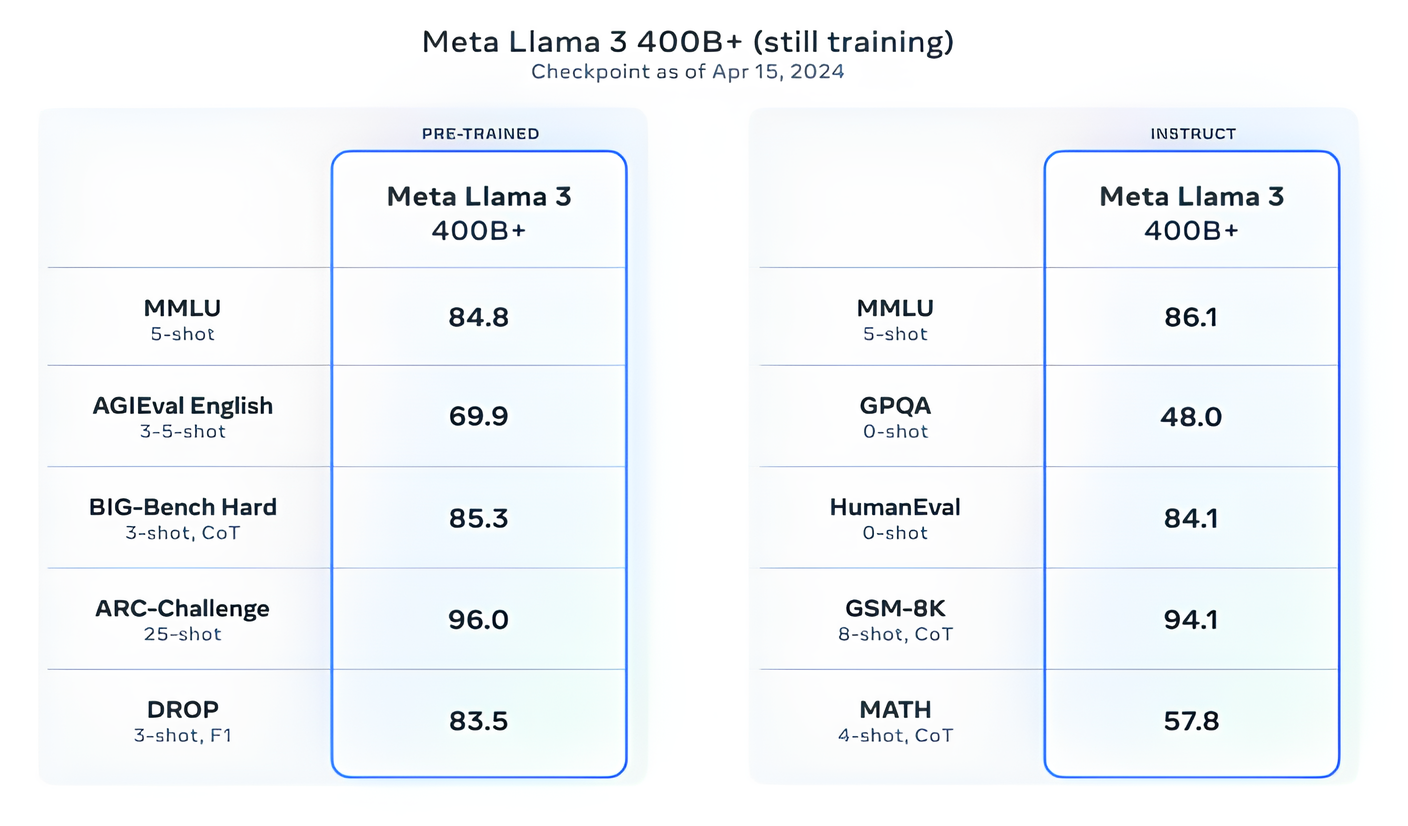

Meta表示,目前正在训练拥有超过4000亿参数的Llama 3模型——这些模型具有“能够用多种语言交流的能力”,可以接收更多数据并理解图像和其他模态,这将使Llama 3系列与Hugging Face的Idefics2等开源版本保持一致。

“我们在不久的将来的目标是让Llama 3变得多语言和多模态,拥有更长的语境,并继续改进在核心[大型语言模型]能力方面,如推理和编码等方面的整体性能,”Meta在一篇博客文章中写道。“还有很多更多的内容即将推出。”

确实。