本周的人工智能:当“开源”并非那么开放

要跟上如人工智能这样快速发展的行业是一项艰巨的任务。因此,在还没有AI可以代劳之前,这里提供了最新的机器学习领域故事的汇总,以及我们没有单独报道的重要研究和实验。

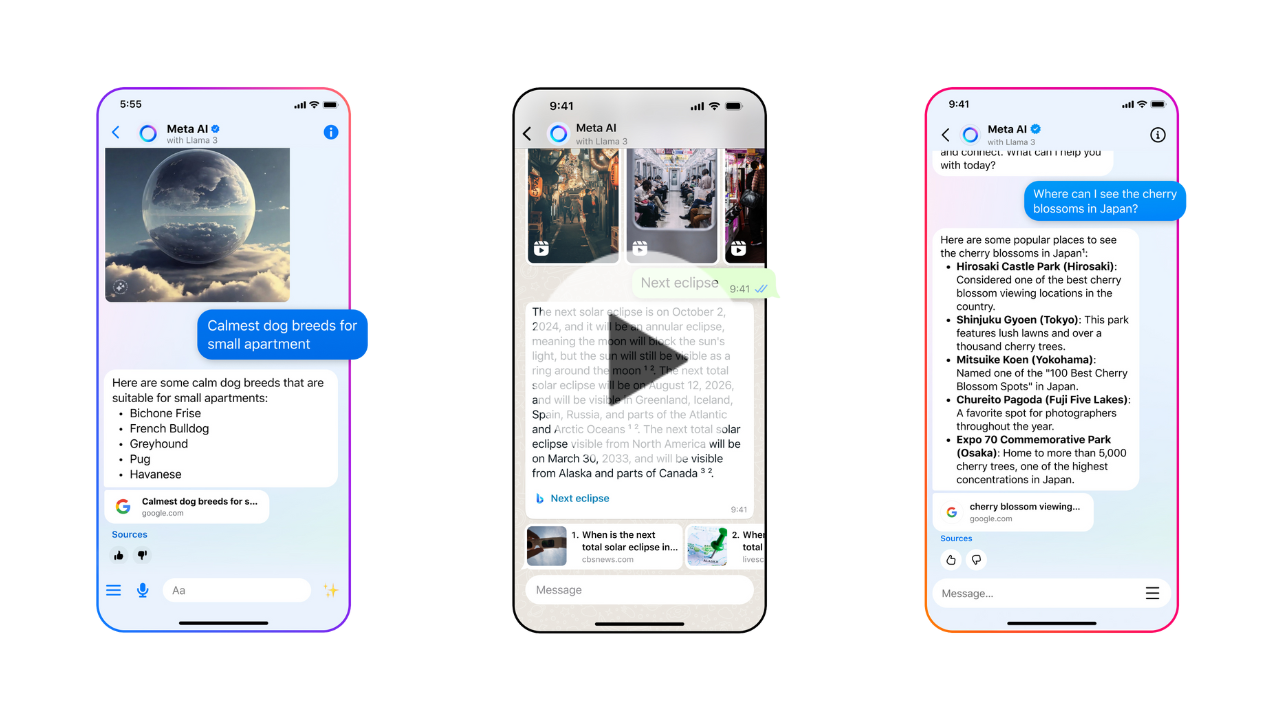

本周,Meta发布了其Llama系列生成式人工智能模型的最新版本:Llama 3 8B和Llama 3 70B。这些模型能够分析和撰写文本,Meta表示这些模型是“开源的”,旨在成为开发者根据其独特目标设计系统的“基础部分”。

Meta在一篇博客文章中写道:“我们相信这些是各自类别中最好的开源模型,没有争议。”“我们正在拥抱开源精神,早期发布并频繁更新。”

只有一个问题:Llama 3型号其实并不是真正的“开源”,至少不符合最严格的定义。

开源意味着开发者可以自由选择如何使用模型。但在Llama 3的情况下,就像在Llama 2中一样,Meta施加了某些许可限制。例如,Llama模型不能用于训练其他模型。拥有超过7亿月活跃用户的应用开发者必须向Meta请求特殊许可证。

关于开源定义的争论并不是新鲜事。但是随着人工智能领域的公司对这个术语玩快又随意,它为长期存在的哲学争论增加了燃料。

去年八月,由卡内基梅隆大学、AI Now研究所和Signal基金会共同撰写的一项研究发现,许多被标榜为“开源”的AI模型都有很大的限制,不仅仅是Llama。训练这些模型所需的数据是保密的。运行它们所需的计算能力超出了许多开发者的能力范围。而优化它们的劳动成本也是难以负担的。

所以如果这些模型并不是真正的开源,那它们到底是什么?这是一个很好的问题;就人工智能开源的定义而言并不是一件容易的事情。

一个尚未解决的问题是:基于开源许可证的基础知识产权机制——版权,是否可以应用于人工智能项目的各个组件和部分,特别是模型的内部结构(例如嵌入)。此外,开源软件的认知与人工智能实际功能之间存在不匹配:开源软件的设计部分是为了确保开发人员可以在没有限制的情况下学习和修改代码。然而,对于人工智能来说,你需要哪些成分来进行学习和修改是开放性的。

在浏览所有不确定性的过程中,卡内基梅隆大学的研究确实清楚地表明,像Meta这样的科技巨头侵占“开源”这个词会带来伤害。

通常,“开源”AI项目像Llama这样最终成为新闻周期的开端 —— 免费营销 —— 并为项目的维护者提供技术和战略优势。开源社区很少能享受到同样的好处,即便有时,与维护者相比,这些好处也是边际的。

研究合著者表示,“开源”人工智能项目,尤其是那些来自大型科技公司的项目,未能实现人工智能的民主化,反而加强和扩大了中央化的权力。下次有重大的“开源”模型发布时,记住这一点。

以下是最近几天一些值得关注的人工智能故事:

- 脸书更新了其聊天机器人:与Llama 3发布同时,脸书在脸书、信使、Instagram和WhatsApp上升级了其人工智能聊天机器人——脸书AI,配备了Llama 3的后台。它还推出了新功能,包括更快的图片生成和访问网页搜索结果。

- AI生成的色情内容:伊万写到监管委员会,即Meta公司的半独立政策委员会,正将注意力转向公司的社交平台如何处理明显的AI生成图像。

- Snap水印:社交媒体服务Snap计划在其平台上为AI生成的图像添加水印。Snap徽标的半透明版本配以一个闪烁的表情符号,这个新水印将被添加到从该应用导出的任何AI生成的图像或保存到相机胶卷中。

- 全新的Atlas:由现代汽车旗下的机器人公司波士顿动力公司发布了其下一代人形机器人Atlas,与前代由液压系统驱动的机器人相比,这个机器人是全电动的,外观更加友好。

- 机器人对机器人:受波士顿动力公司的启发,Mobileye创始人Amnon Shashua推出了一家新创企业Menteebot,专注于研发双足机器人系统。一段演示视频显示Menteebot的原型走向一张桌子并拿起了水果。

- 在一次接受阿曼达采访时,Reddit首席产品官Pali Bhat透露,正在进行一项基于人工智能的语言翻译功能,以吸引更多全球观众加入这个社交网络,还有一个辅助管理工具,它是通过对Reddit版主过去的决定和行为进行训练而实现的。

- 人工智能生成的LinkedIn内容:LinkedIn 已经悄悄开始测试一种增加收入的新方式:LinkedIn 高级企业页面订阅服务,费用似乎高达每月99美元,包括人工智能撰写内容和一套工具来增加关注者数量。

- 标杆项目:谷歌母公司Alphabet的“X”实验室本周推出了项目Bellwether,这是他们最新的尝试,旨在利用技术解决全球一些最大的问题。在这里,这意味着利用人工智能工具尽快识别自然灾害,如森林火灾和洪水。

- 利用人工智能保护儿童:负责执行英国网络安全法的管理机构Ofcom计划展开一项探索,探讨如何利用人工智能和其他自动化工具主动检测和移除在线非法内容,特别是保护儿童免受有害内容的侵害。

- OpenAI登陆日本:OpenAI宣布将扩大到日本,开设了一家新的东京办公室,并计划推出专门针对日语优化的GPT-4模型。

更多的机器学习

瑞士研究人员发现,聊天机器人不仅可以改变你的看法,而且如果他们事先知道一些关于你的个人信息,他们在辩论中可能会比拥有同样信息的人更有说服力。

EPFL 的项目负责人罗伯特·韦斯特说:“这就像是凯姆桥分析计划加强版。” 研究人员怀疑这个模型——这次是 GPT-4——从网络上广泛的论据和事实中汲取,以呈现一个更具说服力和自信的案例。但事实已经证明了一切。韦斯特警告说,在说服方面,不要低估 LLMs 的力量:“在即将到来的美国选举中,人们担心,因为这种技术总是在那里首先经受考验的。 我们能确定的一件事是,人们将利用大型语言模型的力量来试图左右选举。”

为什么这些模型那么擅长语言呢?在这个领域,已经有很长时间的研究历史,可以追溯到ELIZA。如果你对其中一个在这方面有着丰富经验(并且本身也做出了不少贡献)的人感兴趣,可以查看一下有关斯坦福大学的克里斯托弗·曼宁的资料。他刚刚被授予约翰·冯·诺伊曼奖章;恭喜!

在一次标题充满挑衅的采访中,另一位长期从事人工智能研究的研究员(曾经在TechCrunch的舞台上亮相),Stuart Russell和博士后Michael Cohen 推测“如何防止人工智能杀死我们所有人”。也许是个早点解决的好问题!虽然这不是一场肤浅的讨论,但这些聪明的人正在讨论我们如何真正理解人工智能模型的动机(如果这是正确的词),以及应该如何建立围绕它们的法规。

这次采访实际上涉及《科学》杂志本月早些时候发表的一篇论文,论文中提出,能够行动策略性地实现目标的高级人工智能,他们称之为“长期规划代理”,可能无法进行测试。基本上,如果一个模型学会“理解”它必须通过的测试以取得成功,那么它很可能会学会创造性地规避或绕过测试。我们在小范围内已经看到了,何况大规模的呢?

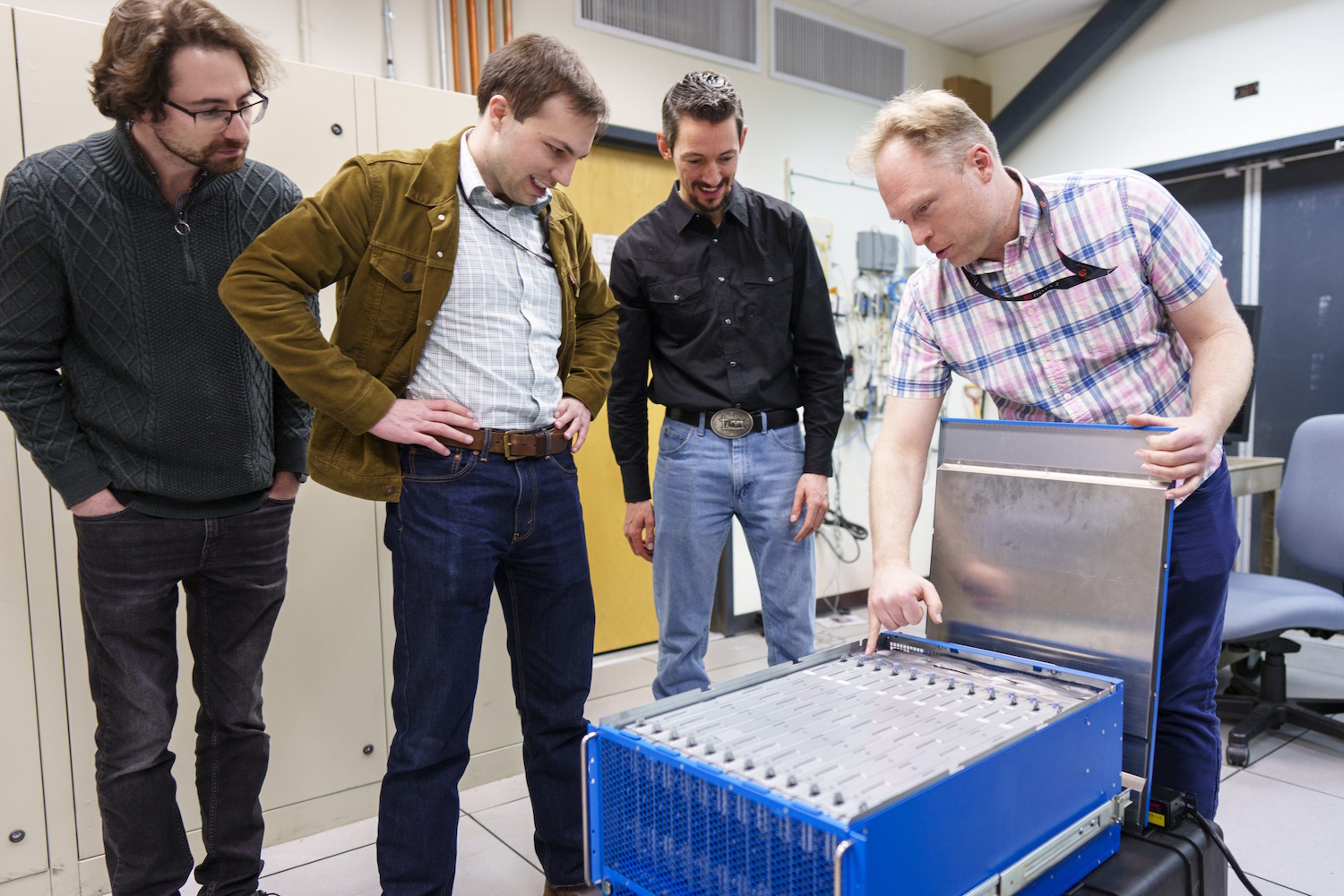

Russell建议限制制造这些智能体所需的硬件...当然,洛斯阿拉莫斯和桑迪亚国家实验室已经收到他们的交付。洛斯阿拉莫斯刚刚为Venado举办了剪彩仪式,这是一台用于人工智能研究的新超级计算机,由2560块Grace Hopper Nvidia芯片组成。

桑迪亚刚刚收到了由英特尔制造的名为哈拉·波恩特的“非凡基于大脑的计算系统”,拥有11.5亿个人工神经元,被认为是世界上最大的系统。这种被称为神经形态计算的技术并非旨在取代像韦纳多这样的系统,而是追求更类似大脑的计算方法,而不是现代模型中我们看到的更统计持重的方法。

"有了这个拥有数十亿神经元的系统,我们将有机会大规模创新出比现有算法更高效更智能的新人工智能算法,以及基于大脑的新方法来优化和建模现有的计算机算法," Sandia 研究员 Brad Aimone 说。听起来不错... 真不错!