Nvidia在GTC的主题演讲带来了一些惊喜

圣何塞 - 在圣何塞的SAP中心座无虚席的观众面前,Nvidia总裁黄仁勋说:“希望你意识到这不是一场音乐会。”这就是他介绍的也许完全相反于音乐会的事件:该公司的GTC活动。“你们来到了一个开发者会议。将会有很多科学描述算法、计算机架构、数学等内容。我感觉到这个房间里压力很大;突然间,你可能会感觉自己来错了地方。”

这可能不是一场摇滚音乐会,但这位61岁、身着皮夹克的世界第三大市值公司的CEO在观众中确实拥有不少粉丝。该公司成立于1993年,旨在推动通用计算超越现有局限。 "加速计算" 成为了英伟达的口号:制造专门用途的芯片和主板会不会很棒呢?英伟达的芯片为那些对游戏画面要求高的玩家提供了所需的工具,让他们可以以更高的分辨率、更高的质量和更高的帧率来玩游戏。

周一的主题演讲,在某种程度上是公司最初使命的回归。“我想向你展示 Nvidia 的灵魂,展示我们公司的灵魂,在计算机图形、物理和人工智能的交汇处,全部在计算机内部交织。”

接下来的两小时里,黄先生做了一件罕见的事情:疯狂地沉迷于技术之中。来参加主题演讲的人们可能期待他像蒂姆·库克一样,进行一场精彩而专注观众的主题演讲,但很有可能会失望。总的来说,这场主题演讲充斥着技术术语,缩略词,毫不掩饰地是一场面向开发者的大会。

我们需要更大的显卡。

图形处理单元(GPU)是英伟达的起源。如果你曾经拼装过电脑,你可能会想到一个插在PCI插槽中的显卡。那是起点,但自那时以来,我们已经走了很长的路。

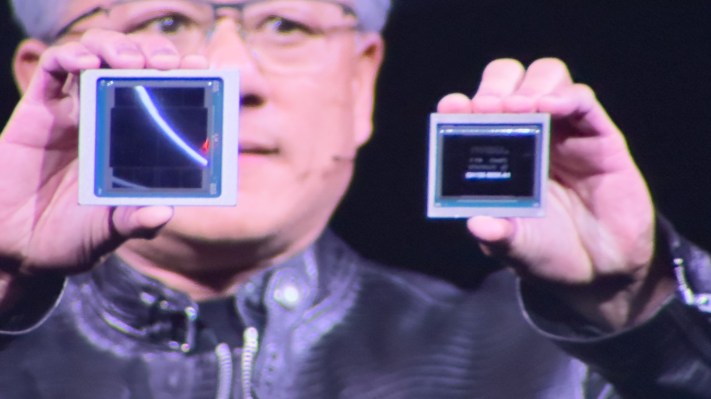

该公司宣布推出全新的Blackwell平台,这是一个绝对的怪物。黄先生表示,处理器的核心是“在物理学的极限上探讨芯片能有多大。”它将两个芯片的功力结合在一起,提供10 Tbps的速度。

"我手上拥有价值约100亿美元的设备," 黄说道,展示了一个Blackwell的原型。 "下一个将花费50亿美元。幸运的是对于你们来说,随后的价格会越来越便宜。将这些芯片组合在一起可以产生一些真正令人印象深刻的功率。"

AI优化GPU的上一代被称为霍普。布莱克韦尔的速度是霍普的2至30倍,具体取决于如何衡量。黄先生解释说,创建GPT-MoE-1.8T模型需要8,000个GPU、15兆瓦的能量和90天的时间。而用新系统,你只需要使用2,000个GPU,并且只需消耗25%的能量。

这些显卡正在高效地处理大量数据 — 这也是黄先生谈到的另一个话题的很好过渡。

接下来是什么?

英伟达为汽车制造商推出了一套新的自动驾驶工具。该公司已经是机器人领域的重要参与者,但它加倍努力推出了新的工具,帮助机器人专家让他们的机器人变得更智能。

该公司还推出了Nvidia NIM,一个旨在简化AI模型部署的软件平台。NIM利用Nvidia的硬件作为基础,旨在通过提供一个AI就绪容器的生态系统来加速公司的AI倡议。它支持来自各种来源的模型,包括Nvidia、谷歌和Hugging Face,并与像亚马逊SageMaker和Microsoft Azure AI这样的平台集成。随着时间推移,NIM将扩展其功能,包括用于生成AI聊天机器人的工具。

黄表示:“只要是可以数字化的东西:只要有一定的结构可以应用一些模式,就意味着我们可以学习这些模式。如果我们能够学习这些模式,就可以理解其含义。当我们理解了含义,就可以生成。而现在我们正处于生成型人工智能革命中。”